Libra: 本地AI Agent构建平台

自然语言交互,有效降低使用门槛

本地算力优先,Token成本直降90%

前沿技术

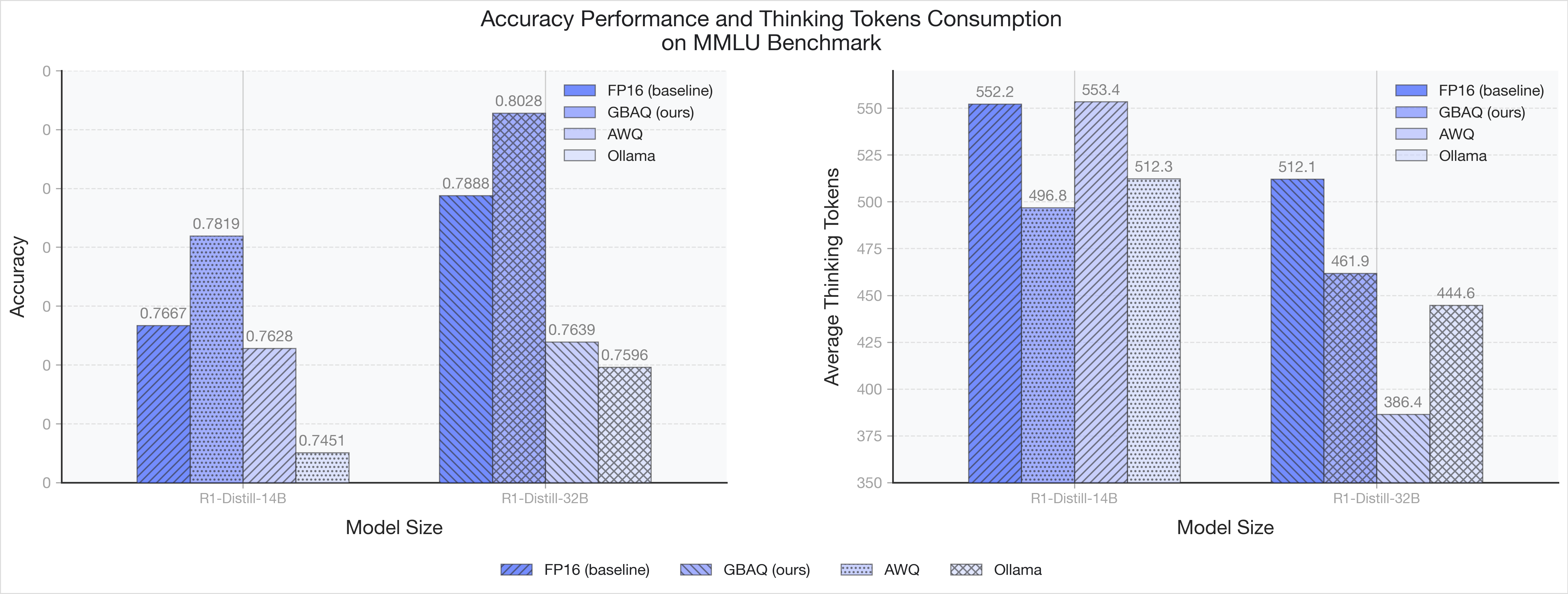

1. 低比特量化技术

采用基于混合精度量化和Reasoning-Aware低比特表征校准技术,将前沿大模型(QwQ 32B、DeepSeek-R1-70B、Deepseek R1 671B等)精准压缩至符合Apple消费级Silicon硬件计算架构的3/4比特混合精度表征,并与Apple MLX机器学习推理框架无缝融合。在性能保持方面,将常规Instruct类大语言模型性能损失精确控制在1%以内,内存需求较FP16模式显著下降75%+。

模型在多种复杂推理任务上能力不降反升,相反,经典量化部署方案(AWQ、GGUF等)表现出对推理模型压缩效果的不稳定性,在多项任务中出现性能、思考效率双降等问题)。

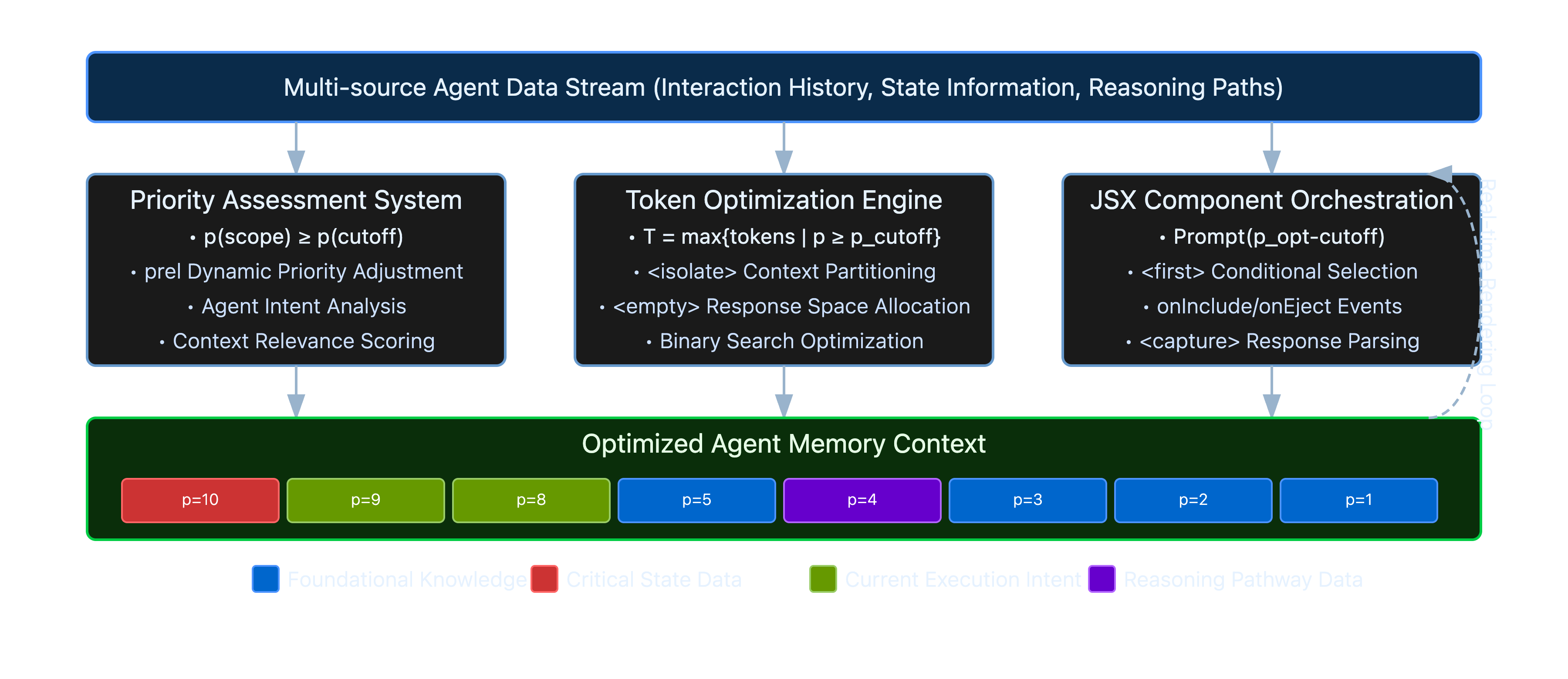

2. 自适应上下文管理架构

TVO基于JSX的层级资源调度策略,对前后端和历史交互数据进行高效整合,并使用专用模型对原始contex进行投机总结与优先级预测,使模型能够预判用户交互意图,对最相关上下文片段进行重排,从而在有限计算资源环境下实现卓越的上下文理解能力。

测试数据表明,这种模型驱动的动态编排架构能有效提升本地AI Agent在长文档分析和多轮复杂对话中的记忆能力和指令跟随能力。特别是在Browser-use这类涵盖百万级Token的场景中,TVO架构能优先保留高价值信息,显著提升模型响应质量。

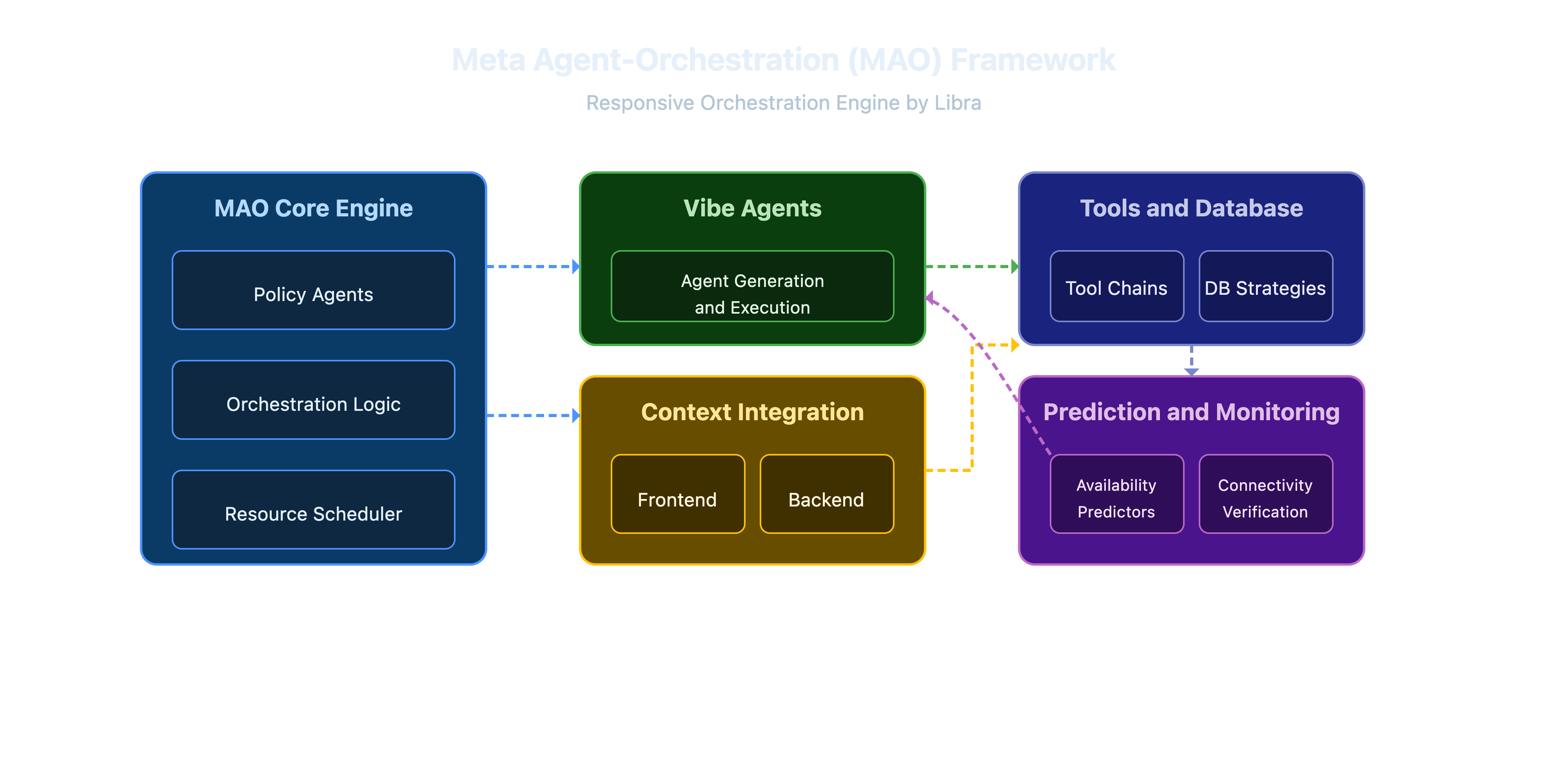

3. 响应式Orchestration框架

MAO框架针对Orchestration场景定制了专用策略智能体,内化了复杂的Orchestration相关知识,使系统够对大量外部工具链、前后端即时交互Context的可用性验证,有效降低了任务失败风险。MAO还针对数据流通层可用性构造了专用预测器,通过实时图联通性验证,实现了自然语言生成Agents的可用性验证,有效降低了任务失败风险